最新研究测试表明:Turnitin AI写作检测模型对非英语母语者没有产生显著性偏见。

Turnitin深知检测错误可能给师生造成的负面影响,不仅会损害学生的声誉,还会给教师增加额外的调查工作。因此,Turnitin也在不断测试和优化检测技术,尽可能地降低误报的发生率。

误报是指错误地将人类撰写的文本识别为AI生成的文本。目前,对于AI检测值低于20%的文稿,Turnitin用星号提醒教师该分数仅供参考,数据不一定准确。对于AI检测值高于20%的文稿,误报率将低于1%。

除了对误报的担忧,教师也十分关心AI写作检测功能是否会对非英语母语的写作者产生偏见。为了回答这个问题,Turnitin使用开放数据集的样本进行了进一步的测试。

测试过程

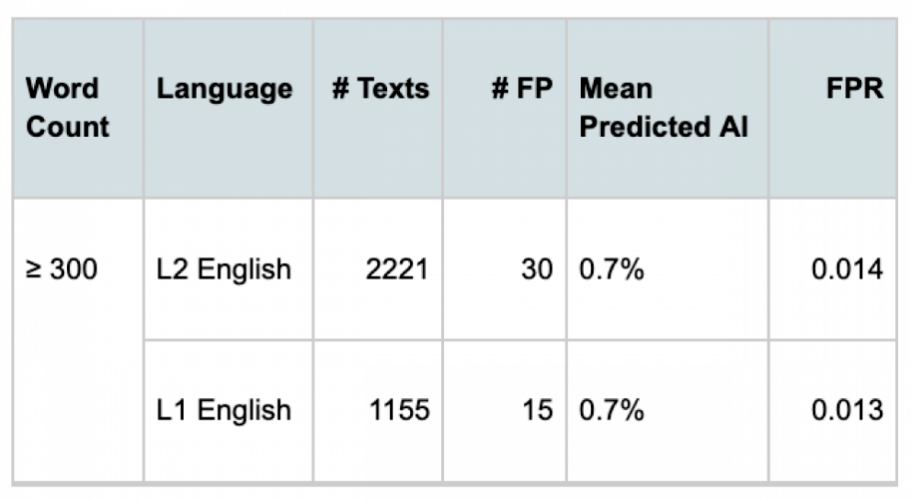

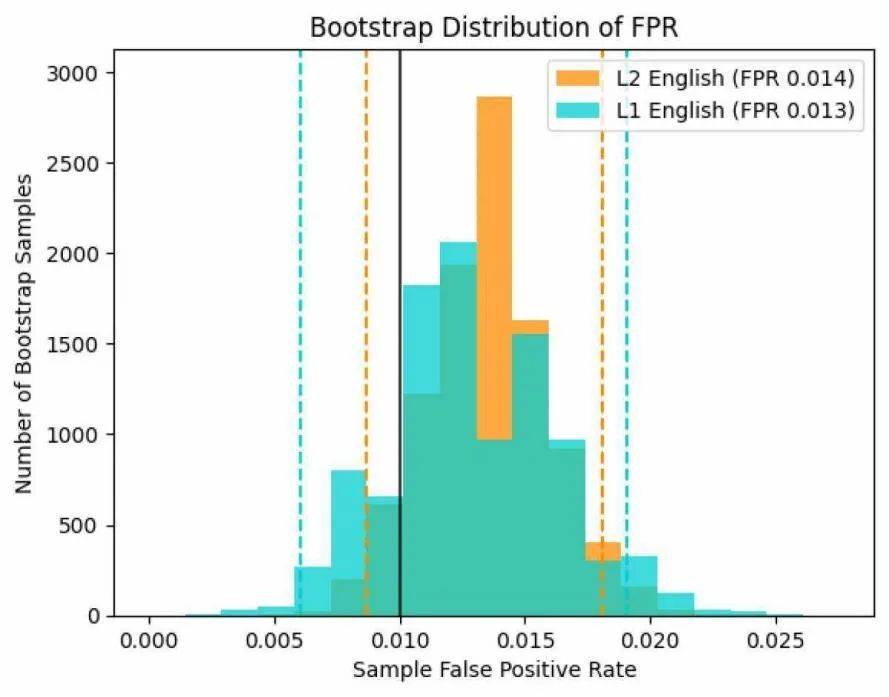

Turnitin根据语言背景将开放数据集的样本划分为L1 English(英语母语写作者)和L2 English(非英语母语写作者),并根据字数将文稿分为不满300字或300字及以上。经授权,Turnitin从上述不同组合中最多抽取了2000份样本。(请注意,这些样本并不包含在训练AI写作检测模型的数据集中,仅用于本次测试。)

测试结果

L1 English代表英语母语的写作者 L2 English代表非英语母语的写作者 FPR代表误报率

测试结果表明,对于300字及以上的文稿,L2 English非英语母语组和L1 English英语母语组之间的误报率差异仅为0.1%,不具备统计显著性。这说明Turnitin AI检测模型对非英语母语的写作者不存在显著性偏见。此外,对于太短的文稿,误报率的差异更大,再次验证Turnitin AI写作检测功能在长文稿中的准确性会更高。

结论

经测试,若检测文稿的字数在300字至15000字之间,Turnitin AI写作检测模型并不会对非英语母语的写作者产生显著性偏见。随着大语言模型不断进化,Turnitin将继续改进AI写作检测能力,为教育者提供安全可靠的解决方案。